Face aux déluges d’images de vidéosurveillance et face à l’abondance d’applications hyper ciblées en intelligence artificielle (IA), les éditeurs s’efforcent de créer la confiance en respectant les données personnelles dès la capture des images.

Règlement général pour la protection des données personnelles (RGPD), révision de la directive Network Internet Security (NIS 2), Digital Service Act (DSA), Digital Markets Act (DMA), Cyber Resilience Act… l’Europe avance à pas de géant vers un monde numérique de confiance. Surtout à l’heure où l’intelligence artificielle ne cesse d’étendre sa couverture fonctionnelle : comptage de personnes, détection d’intrusion, reconnaissance faciale, analyse comportementale, reconnaissance sonore, détection automatique d’anormalités, lecture automatique de plaques d’immatriculation, abandon de colis, dépôts sauvages de déchets sur la voie publique… En quelques années, la liste s’est tellement rallongée que de nombreux éditeurs de solutions d’IA en sécurité-sûreté proposent un modèle économique de licences flottantes (pas liées à une seule caméra de vidéosurveillance) dotées de plusieurs dizaines de fonctionnalités qui s’enrichissent tous les semestres. Comment créer une IA de confiance en sécurité-sûreté ?

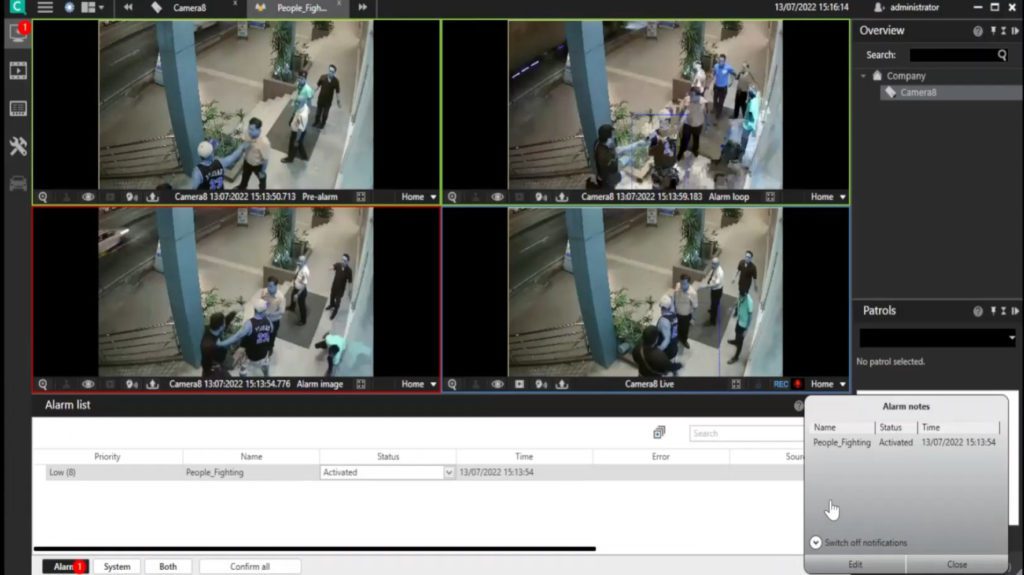

L’application d’IA de Viisights s’intègre à de nombreux VMS, dont, ici, celui de Qognify. © Viisights

Compréhension de situations en temps réel

Illustration avec la société israélienne Viisights, spécialisée dans l’analyse vidéo en temps réel par reconnaissance comportementale pour les villes, les entreprises, les campus, les banques, les institutions financières, les infrastructures critiques, les centres de transport, les installations industrielles et les établissements de soin. « Au départ, notre solution cible les établissements de soin qui accusent une violence au travail cinq fois plus importante que dans d’autres secteurs. 73 % de toutes les agressions sur les lieux de travail se produisent sur des professionnels de santé. 12 % des infirmières des services d’urgence sont agressés physiquement chaque semaine », indique, lors d’une réunion de l’AN2V, Eli Zenouda, directeur commercial de Viisights qui prévoit une forte demande en analyse vidéo temps réel par intelligence artificielle d’ici 2025. Pour toucher le marché européen, la société israélienne se conforme au RGPD.

Particularité de Viisights, elle fournit une détection et une prédiction de ce qui est sur le point de survenir : activité suspecte, utilisation d’une arme à feu… « Or, même si l’exploitant installe un grand nombre de caméras de vidéosurveillance, les agents de sécurité ne comprennent pas toujours bien ce qu’il se passe. C’est pourquoi nos algorithmes s’attachent à comprendre les situations afin de prendre les bonnes décisions, l’intérêt étant notamment de réduire les fausses alertes », reprend Eli Zenouda dont l’offre s’intègre aux VMS aux superviseurs vidéo de CASD, Cognyte, Genetec, Milestone et Qognify. Le tout en reprenant les flux vidéo de n’importe quelle caméra. « Nos concentrons près d’une cinquantaine de fonctionnalités d’intelligence artificielle et facturons au nombre de cas d’usage demandés », poursuit le directeur commercial. Citons, pêle-mêle la détection de vandalisme, de comportements violents ou d’activités suspectes, la détection de comportement de personnes armées, les départs de feu… Important : le système reconnaît non pas la personne ou l’arme à feu mais le comportement de la personne qui veut s’en servir. Ce qui en fait une solution respectant, selon Viisights, le RGPD. « Après la reconnaissance d’objets dans des images, nous en sommes aujourd’hui à la compréhension de la vidéo, c’est-à-dire de scènes, d’actions et d’événements, enchaîne Eli Zenouda. Mais les futurs développements vont porter l’analyse prédictive sur la recommandation d’actions pour prévoir les situations d’intérêt. »

Les systèmes d’analyse vidéo se rendent compatibles avec le RGPD. © Mickael Dziedzic / Unspalsh

Anonymiser les données vidéo dès la capture

Autre solution respectant de RGPD dès la conception, celle de la start-up française Kooping, spécialisée dans la transformation des flux vidéo en données métiers. « L’année dernière, on dénombrait près d’un milliard de caméras de vidéosurveillance dans le monde. Mais 98,84 % de leurs images sont inexploitables. Et seulement 0,16 % des flux vidéo sont visualisés de façon attentive », remarque Marc Descombas, docteur en intelligence artificielle appliquée à la vidéosurveillance, fondateur de Kooping à Evreux (Eure) en 2020. En moyenne, un opérateur gère une dizaine d’écrans. Chaque écran concentre les flux d’une dizaine de caméras. Ce qui amène à visualiser 400 heures de vidéo par opérateur et par jour. Impossible d’y arriver sachant que, selon une étude scientifique (Dadashi N, Stedmon a and Pridmore T. Automatic Components of Integrated CCTV Surveillance Systems : Functionality, Accuracy and Confidence. IEEE AVSS’09 2009 ; 376–381) l’attention de l’opérateur ne tient pas plus de 40 minutes, en moyenne.

Docteur en intelligence artificielle appliquée à la vidéosurveillance, Marc Descombas est fondateur de Kooping. © Kooping

Face à ce constat, Kooping propose une méthode de mesure intégrée à une logique d’amélioration continue. « Nous installons une box 100 % fabriquée en France chez nos clients qui récupère les flux des caméras vidéo existantes, sécurise la transmission des données et opère un pré-traitement d’anonymisation des données. En clair, la box floute les images. Seule l’IA est alors capable de les lire. Puis, le client accède à un catalogue d’applications d’IA interchangeables développées autour des enjeux RGPD, décrit Marc Descombas. Ensuite, nous offrons une vision temporelle des mesures, des chiffres agrégés et des résumés de vidéos taguées. » Parmi les applications d’IA, citons, dans un groupe de BTP, la cohabitation entre salariés et véhicules sur un chantier de construction, le respect par les salariés du port des équipements de protection (EPI) et des marquages au sol. « Le groupe de BTP a 450 sites à surveiller. Ce qui l’intéresse, c’est d’avoir des chiffres et des tendances, pas de savoir qui ne porte pas le casque. Notre procédé a alors conduit à un contrôle continu de la stratégie Hygiène, sécurité, environnement (HSE) du groupe de BTP ainsi qu’au rappel des mesures à suivre auprès des personnels, confie Marc Descombas qui est en train de breveter son procédé d’IA compatible RGPD afin que la surveillance vidéo n’oppresse pas les salariés. Nous prônons la sensibilisation des salariés plutôt que leur flicage. » Autre application pour une ville : la mesure des dépôts sauvages près des points de tri sélectif. Objectif : cibler l’intervention des services de ramassage afin d’éviter l’accumulation des déchets sur la voie publique.

Erick Haehnsen

Commentez